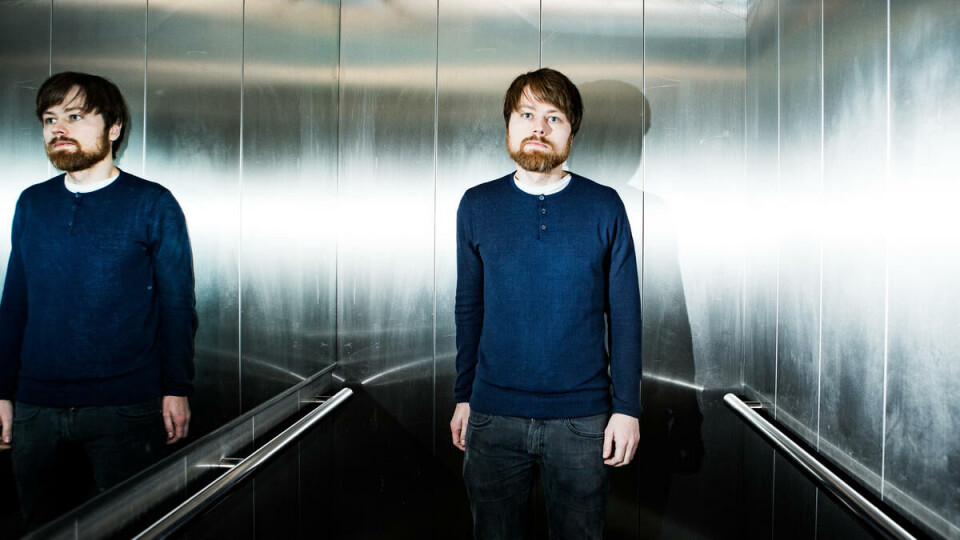

Andreas Brekke Carlsson: Drapsrobotene kommer

Det kan høres ut som en middels bra episode av Black Mirror, men om ikke lenge kan drapsrobotene ta steget ut av kinolerretet og inn i virkeligheten

– Fullt autonome våpen kan selv velge ut og angripe mål uten menneskelig overoppsyn, forteller Andreas Brekke Carlsson, forsker ved ConceptLab på IFIKK og sekretær i Etisk råd for forsvarssektoren.

Han mener spørsmålet om når disse våpensystemene blir tatt i bruk er like mye politisk som teknologisk.

– Utviklingen mot systemer som selv kan skille mellom sivile og stridende vil være gradvis. Når eller om våpnene kommer vil avhenge av hva slags regulering som kommer på plass, og hva slags teknologi stater mener er god nok.

13. november i fjor møttes representanter fra 125 FN-land i Genève for å diskutere et forbud mot autonome våpen. De mener våpnene setter sivile liv i fare. Våpnenes tilhengere innvender at roboter ikke trenger lønn eller pensjon, ikke kan utføre krigsforbrytelser, og ikke etterlater sørgende pårørende. Forbudet har foreløpig ikke gått gjennom.

Forskerintervju: Hvite måneder kan skade mer enn det fikser

– Det vanligste argumentet for er at mennesker ikke er særlig gode til å handle etisk når de bedriver krig. Militærhistorien gir endeløse eksempler på at sivile drepes, voldtas og tortureres.

Carlsson nevner hevnlyst, svakt lederskap, avhumanisering av fienden, dårlig trening eller uerfarne soldater, sadisme, frustrasjon og ytre press som mulige forklaringer på hvorfor krigsforbrytelser vedvarer.

– Forsvarere av autonome våpen påpeker at disse ikke vil påvirkes disse faktorene. De trenger ikke å ha programmert inn selvoppholdelsesdrift, og de vil ikke påvirkes av frykt, sinne og frustrasjon.

Det vanligste argumentet for er at mennesker ikke er særlig gode til å handle etisk når de bedriver krig.

Vel så viktig er et argument som handler om egne soldaters risiko. Carlsson sier det er etisk problematisk å utsette egne soldater for mer fare enn det som er nødvendig. Autonome våpen vil, i likhet med fjernstyrte droner, eliminere risikoen involvert i for eksempel jagerflyangrep og bakketropper.

– Men man kan ikke minimere risiko for egne soldater på bekostning av risiko for sivilbefolkningen. Man kan dessuten tenke seg at selv om våpenet brukes i et legitimt angrep, og leder til færre sivile tap, kan bruken av denne teknologien lede til et internasjonalt våpenkappløp eller senke terskelen for krigføring, noe som vil være moralsk problematisk, mener han.

Forskerintervju: Thomas Thwaites dro til seters for å bli geit

Andre motargumenter handler om teknologiens kapasitet til å skille mellom sivile og stridende. Men selv teknologien skulle bli god nok på dette området er det alltid en fare for at våpnene misbrukes. Carlsson tror at etter hvert som teknologien utvikles, vil den bli billigere og lettere tilgjengelig. Han sammenligner autonome våpen med en sosiopatisk soldat som kun motiveres av å følge regler, og viser til filosofer som mener det er problematisk å bruke våpensystemer som i en viss forstand gjør beslutninger uten å motiveres av moralske grunner. Her kan man imidlertid innvende at de samme reglene ikke nødvendigvis gjelder for maskiner som for mennesker.

– Det er ingen som mener at landminer eller missiler er problematiske fordi de ikke handler etter moralske grunner. Så mye av debatten dreier seg om hvorvidt man skal betrakte autonome våpen som et redskap eller som en aktør.

Forskerintervju: Rynker, potensproblemer og tørr skjede til tross, pensjonister kan også kunsten å pule

I 2015 advarte 3100 forskere mot autonome våpen i et åpent brev til FN. Stephen Hawking, Elon Musk, Noam Chomsky og Apples Steve Wozniak var blant underskriverne. De sammenlignet autonome våpen med kjemiske og biologiske våpen, og påpeker at de vil være lettere å lage enn atomvåpen. Scenarier der våpnene havner på svartebørsen eller hos terrorister, totalitære regimer eller krigsherrer som vil begå etnisk rensing ble nevnt. Carlsson tror forskerne har rett i at dette er bekymringer man bør ta svært alvorlig.

– Autonome våpen kan medføre noen vanskelige avveininger. Hvis, og det er et stort hvis, de blir bedre enn mennesker til å skille mellom sivile og stridende og gjøre nødvendige vurderinger, har vi en grunn til å utvikle og bruke teknologien. Men dette må i såfall veies opp mot andre, vanskelig overskuelig hensyn.